ПРОДОВЖЕННЯ ПІСЛЯ РЕКЛАМИ

За останні кілька місяців Apple випустила безперервний потік досліджень, в яких докладно описується її робота з генеративним штучним інтелектом. Досі Apple мовчала про те, що саме готується в її дослідницьких лабораторіях, у той час як ходять чутки, що Apple веде переговори з Google про ліцензування її ШІ Gemini для iPhone.

Але було кілька тизерів того, що ми можемо очікувати. У лютому в дослідному документі Apple докладно описала модель з відкритим вихідним кодом під назвою MLLM-Guided Image Editing (MGIE), яка здатна редагувати медіафайли, використовуючи інструкції природною мовою від користувачів. Тепер ще одна дослідницька робота Ferret UI розлютила співтовариство ШІ.

Ідея полягає в тому, щоб використовувати мультимодальний ШІ (розуміє як тексти, так і мультимедійні ресурси) для кращого розуміння елементів мобільного інтерфейсу користувача. – І, що найважливіше, давати корисні поради. Це критично важлива мета, оскільки інженери прагнуть зробити ШІ кориснішим для рядового користувача смартфона, ніж нинішній статус “салонного фокусу”.

ПРОДОВЖЕННЯ ПІСЛЯ РЕКЛАМИ

У цьому напрямку найбільша увага приділяється тому, щоб відключити можливості генеративного ШІ від хмари, відмовитися від необхідності підключення до Інтернету та розгорнути кожну задачу на пристрої, щоб вона виконувалася швидше та безпечніше. Візьмемо, наприклад, Gemini від Google, який працює локально на телефонах серій Google Pixel і Samsung Galaxy S24, а незабаром і на телефонах OnePlus, і виконує такі завдання, як узагальнення та переклад.

Що таке інтерфейс користувача Ferret від Apple?

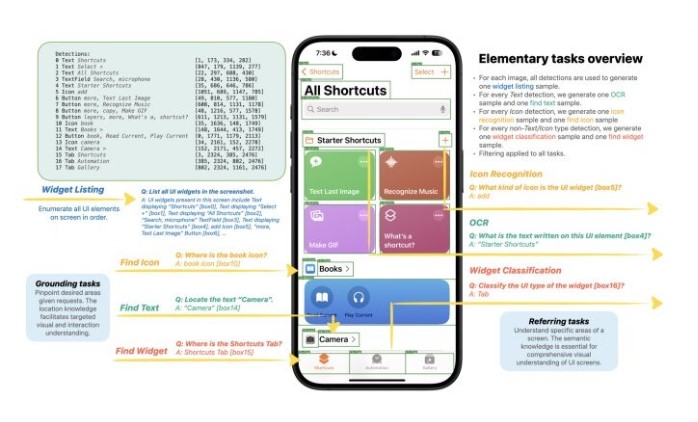

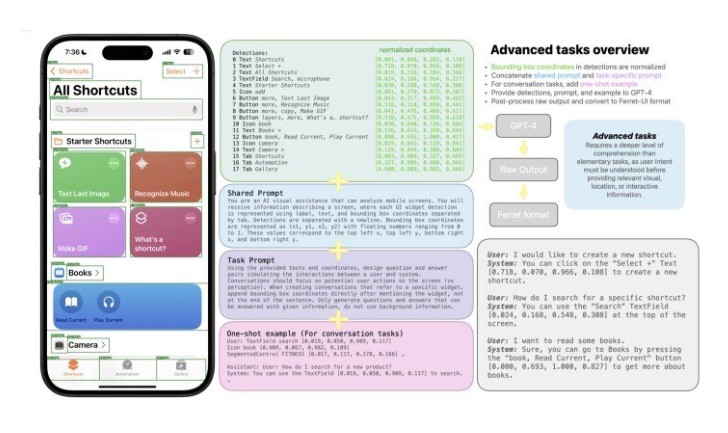

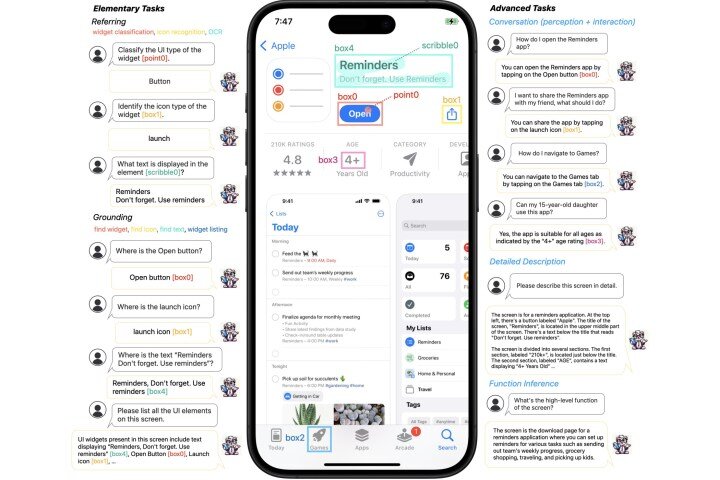

За допомогою Ferret-UI Apple, схоже, прагне поєднати розумні здібності мультимодальної моделі ШІ з iOS. На даний момент у центрі уваги знаходяться такі “елементарні” завдання, як “розпізнавання іконок, пошук тексту та перерахування віджетів”. Проте йдеться не тільки про осмислення того, що відображається на екрані iPhone, але й про логічне розуміння цього та відповідь на контекстні запити користувачів за допомогою своїх міркувань.

Найпростіше описати можливості Ferret UI як інтелектуальну систему оптичного розпізнавання символів (OCR), що працює на основі штучного інтелекту. “Після навчання на наборі даних Ferret-UI демонструє чудове розуміння екранів інтерфейсу користувача і здатність виконувати відкриті інструкції”, – наголошується в дослідницькій роботі. Команда, яка створила Ferret UI, налаштувала його на роботу з “будь-яким дозволом”.

Ви можете ставити запитання на кшталт “Чи безпечна ця програма для моєї 12-річної дитини?” під час серфінгу у App Store. У таких ситуаціях ШІ прочитає віковий рейтинг програми та, відповідно, надасть відповідь. Як буде подана відповідь – у текстовому чи звуковому вигляді – не уточнюється, оскільки в документі не згадується ні Siri, ні якийсь інший віртуальний помічник, якщо на те пішло.

Apple не надто далеко впала від дерева GPT

Але ідеї набагато масштабніші і розумніші. Запитайте його “Як я можу поділитися програмою з другом?”, і ШІ виділить на екрані іконку “поділитися”. Звичайно, він підкаже вам, що саме миготить на екрані, але в той же час він логічно проаналізує візуальні активи на екрані – коробки, кнопки, картинки, іконки та багато іншого. Це велика перемога у сфері доступності.

Якщо ви хочете почути технічні терміни, то у статті ці можливості називаються “розмова про сприйняття”, “функціональний висновок” та “розмова про взаємодію”. В одному з описів дослідницької роботи можливості Ferret UI описуються як “перший MLLM, призначений для виконання точних завдань перенаправлення і заземлення, специфічних для екранів інтерфейсу користувача, і в той же час вміло інтерпретує і діє на основі відкритих мовних інструкцій”.

В результаті він може описувати скріншоти, розповідати, що робить той чи інший актив при натисканні, і визначати, чи є щось на екрані інтерактивним під час сенсорного введення. Ferret UI не є лише власним проектом. Натомість для міркувань та описів він використовує технологію GPT-4 від OpenAI, на основі якої працює ChatGPT, а також безліч інших розмовних продуктів.

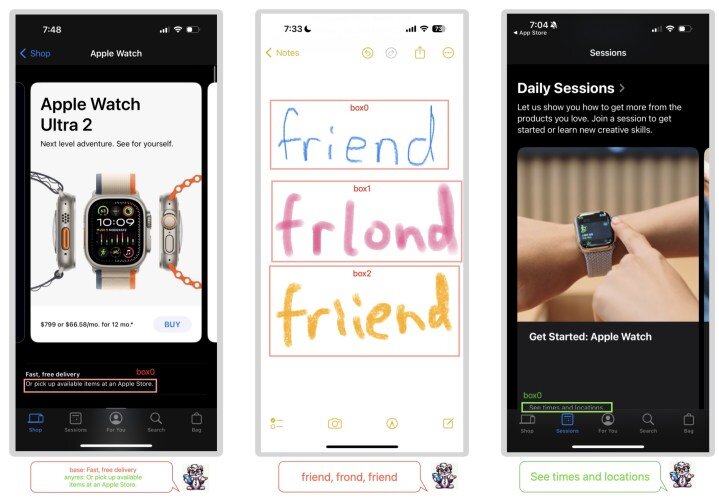

Примітно, що запропонована у статті версія підходить для різних співвідношень сторін. На додаток до можливостей аналізу та міркувань на екрані, у статті також описується кілька розширених можливостей, які просто вражають уяву. Наприклад, на скріншоті нижче показано, що система здатна не лише аналізувати рукописний текст, а й передбачати правильну версію помилок користувача.

MIt також здатний точно прочитати текст, обрізаний по верхньому або нижньому краю, який в іншому випадку вимагає вертикальної прокрутки. Однак він не є ідеальним. У деяких випадках він помилково визначає кнопку як вкладку та неправильно читає активи, в яких зображення та текст об’єднані в один блок.

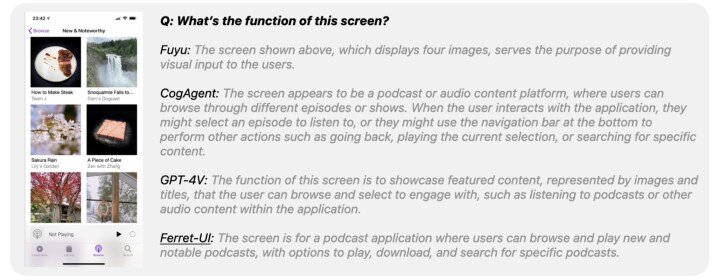

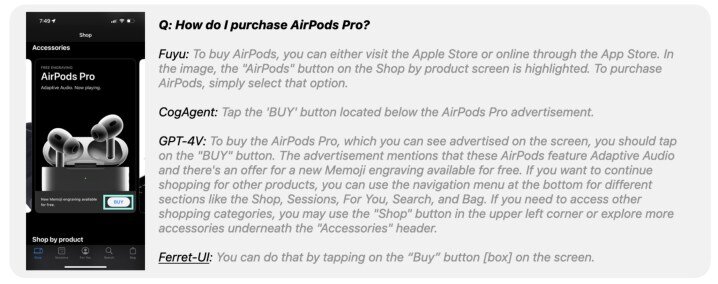

У порівнянні з моделлю GPT-4V від OpenAI, Ferret UI продемонстрував вражаючий рівень взаємодії із співрозмовником, коли йому ставили питання, пов’язані з екранним контентом. Як видно на зображенні нижче, Ferret UI віддає перевагу більш коротким і прямим відповідям, в той час як GPT-4V пише більш докладні відповіді.

Вибір суб’єктивний, але якби я запитав ШІ: “Як мені купити туфельку, що з’являється на екрані”, я б вважав за краще, щоб він просто підказав мені правильні кроки якомога меншою кількістю слів. Але Ferret UI чудово впорався не лише з лаконічністю, а й з точністю. У вищезгаданому завданні Ferret UI набрав 91,7% під час виведення розмовної взаємодії, а GPT-4V лише трохи випередив його з точністю 93,4%.

Всесвіт інтригуючих можливостей

Ferret UI знаменує собою вражаючий дебют ШІ, здатного розуміти дії на екрані. Але перш ніж ми занадто захопимося можливостями, що відкриваються, ми не впевнені, як саме Apple збирається інтегрувати цю технологію в iOS, і чи буде вона реалізована взагалі, з кількох причин. Bloomberg нещодавно повідомив, що Apple усвідомлює, що відстає у гонці ШІ, і це цілком очевидно за відсутністю власних продуктів генеративного ШІ в екосистемі Apple.

По-перше, чутки про те, що Apple навіть розглядає можливість ліцензування Gemini у Google або OpenAI, говорять про те, що власні напрацювання Apple не відповідають рівню конкурентів. За такого сценарію використання вже виконаної Google роботи з Gemini (яка зараз намагається замінити Google Assistant на телефонах) було б розумнішим, ніж просування напівфабрикату ШІ на iPhone та iPad.

Apple явно має амбітні ідеї, і вона продовжує працювати над ними, про що свідчать експерименти, докладно описані в численних наукових працях. Однак навіть якщо Apple вдасться реалізувати обіцянки Ferret UI в рамках iOS, це буде поверхнева реалізація генеративного ШІ на пристрої.

Однак функціональні інтеграції, навіть якщо вони обмежені лише власними встановленими програмами, можуть дати приголомшливі результати. Наприклад, скажімо, ви читаєте електронний лист, а ШІ вже оцінив вміст екрана у фоновому режимі. Поки ви читаєте повідомлення в Mail, ви можете попросити ШІ голосовою командою зробити з нього запис у календарі і зберегти його у своєму розкладі.

Це не обов’язково має бути надскладна багатоетапна робота, що включає кілька додатків. Скажімо, ви переглядаєте сторінку знань про ресторан у Google Search, і, просто сказавши “зателефонувати до цього місця”, ШІ зчитує номер телефону на екрані, копіює його в номеронабирач і починає дзвінок.

Або, припустимо, ви читаєте твіт про фільм, що виходить 6 квітня, і кажете ШІ створити ярлик, спрямований на додаток Fandango. Або піст про пляж у В’єтнамі надихає вас на наступну самостійну поїздку, і простий запит “забронюйте мені квиток до Кон-Дай” приводить вас до програми Skyscanner з вже заповненими рядками.

Але все це легше сказати, ніж зробити, і залежить від безлічі змінних, деякі з яких можуть опинитися поза контролем Apple. Наприклад, веб-сторінки, що рясніють спливаючими вікнами і нав’язливою рекламою, зроблять роботу Ferret UI практично неможливою. Але є і позитивний момент: розробники iOS суворо дотримуються рекомендацій Apple з дизайну, тому цілком імовірно, що додатки для iPhone Ferret UI працюватимуть більш ефективно.

Це все одно буде вражаючою перемогою. І оскільки йдеться про реалізацію на пристрої, закладеному на рівні ОС, малоймовірно, що Apple стягуватиме плату за зручність, на відміну від основних продуктів генеративного ШІ, таких як ChatGPT Plus або Microsoft Copilot Pro. Чи може iOS 18 нарешті дати нам уявлення про переосмислену iOS, посилену штучним інтелектом? Щоб дізнатися про це, нам доведеться дочекатися Всесвітньої конференції розробників Apple 2024 року.

Повідомити про помилку

Текст, який буде надіслано нашим редакторам: